人工皮肤—基于视触觉传感的三维重建技术:材料、方法和评估

本文来源于Advanced Functional Materials, 欢迎浏览!

论文信息

论文背景

人工皮肤在机器人感知和医疗保健方面显示出巨大的潜力。它提供了包括三维形状重建、接触反馈和温度感知在内的多功能触觉感知,其中三维重建功能是灵巧手在触觉认知和互动中不可或缺的。视觉触觉传感器(VTS)是一种创新的仿生触觉传感器,与电子触觉传感器相比,它支持高分辨率、高精度、高密度的触觉重建。

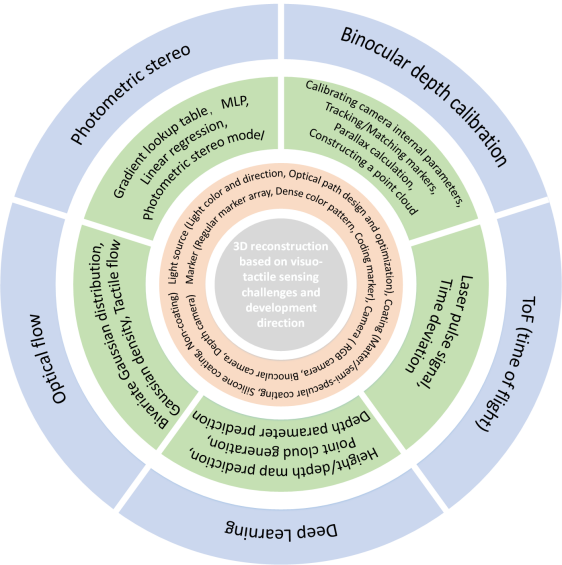

图1 基于视触觉传感三维重建技术概览

论文概述

近期,北京邮电大学方斌教授团队以视触觉传感为视角,总结了人工皮肤的三维重建功能的技术细节及发展脉络。根据传感方式、硬件类别和建模方式,将三维重建技术分成5类:1)光度立体;2)深度标定;3)光流;4)深度学习;5)深度相机。其次,从硬件角度阐述了重建方法的关联和区别。结合近十五年的文献调研,对三维重建的发展和技术迭代进行了讨论。最后,总结现在三维重建研究的挑战,并提出了未来发展趋势。该工作以“Artificial Skin Based on Visuo-Tactile Sensing for 3D Shape Reconstruction: Material, Method, and Evaluation”为题发表在Advanced Functional Materials。该研究得到国家自然科学基金委的支持。

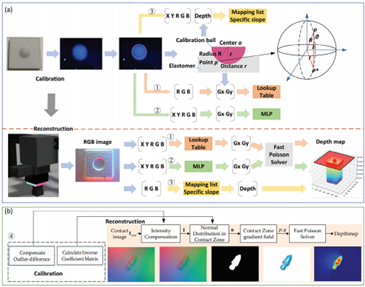

图2 基于光度立体三维重建

光度立体法应用于涂层型视触觉传感器。通过多方向、不同光色的照明,在接触区域提供鲜明的梯度变化。为了减少阴影的影响,通过光路设计和光学优化来提高光照的均匀性。使用特定尺寸的校准球可以标定出Gx和Gy。通过查找表(哑光涂层)或者MLP(半镜面涂层)从光照强度预测梯度信息,并结合泊松求解器计算深度值。MLP对平面和曲面重建都具有通用性,并且简化了查找表的生成。当成像环境足够稳定,单色光也能提供足够的梯度信息,并且RGB与梯度的映射关系趋近于线性拟合。

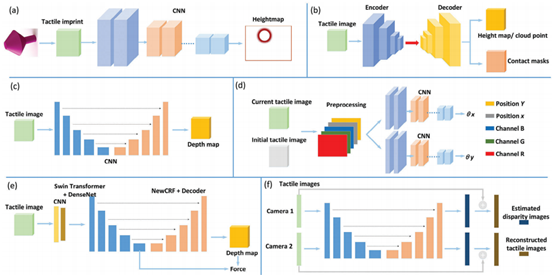

图3 基于深度学习三维重建

深度标定和光流法适用于标记型视触觉传感器。深度标定依靠双目视觉和标记层来获取视差,进一步推导出深度信息。标记追踪是标定的关键环节。标记物尺寸太小会导致图像处理过程中出现漏点现象。在标记匹配阶段,打乱标记阵列排序,导致左右相机不能追踪到同一个标记。图像分割网络可以避免图像处理的误差,对微型化标记的追踪提供支持。光流法是基于单目相机的深度预测。对流向量应用二维高斯分布核,并在每个点对分布进行累积,得到高斯密度。表面变形的相对深度可以直接从负高斯密度来估计。标记物的随机性提高了触觉数据的鲁棒性。

深度学习方法具有高兼容性。通过数据驱动方式,直接构建RGB与深度信息的映射。深度信息的表达形式多样,包括高度/深度图、点云信息和梯度角。与上述重建方法结合,深度学习可以预测关键参数,简化非线性模型的建立。深度相机可以直接输出深度值,但是需要预留较大的传感空间,导致传感器体积庞大。这不符合视触觉传感器微型化的发展趋势。对于未来发展,本文认为视触觉传感将关注多模态融合、曲面重建和高分辨率三维重建。这也符合机器人交互感知和自适应感知的需求。

如果篇首注明了授权来源,任何转载需获得来源方的许可!如果篇首未特别注明出处,本文版权属于 X-MOL ( x-mol.com ), 未经许可,谢绝转载!

京公网安备 11010802027423号

京公网安备 11010802027423号